Aby przystąpić do pozycjonowania strony internetowej, należy wykonać jej audyt. Wyniki badania dotyczą m.in. jakości strony. Jest niezwykle ważna, ponieważ to w dużej mierze od niej będą zależały szybkość i łatwość uzyskiwania efektów SEO. Na podstawowym poziomie jakość strony internetowej możesz sprawdzić samodzielnie. W dzisiejszym artykule opisaliśmy narzędzia, dzięki którym zweryfikujesz na przykład to, czy strona internetowa szybko się wczytuje oraz jest prawidłowo wyświetlana niezależnie od urządzeń (mobilnych, desktopowych) i przeglądarek. Zapraszamy!

Jakość strony a pozycja w wynikach wyszukiwania

Jakość strony internetowej ma znaczenie nie tylko dla skuteczności działań SEO, ale również satysfakcji użytkowników. Poprawność kodu CSS i HTML, błyskawiczne wczytywanie podstron, czytelna nawigacja za pomocą linków czy wyczerpujące treści w opisach produktów i usług to przykładowe elementy, dzięki którym strona jest lepiej odbierana przez potencjalnych klientów i w następstwie przez roboty Google.

Zależnie od jakości stron te oceniane przez algorytm lepiej są częściej wyświetlane na wysokich pozycjach wyników wyszukiwania. Tym samym pozwalają docierać do większej liczby potencjalnych klientów. Warto, byś sobie uświadomił, że dbając o stronę, dbasz o użytkowników, a pośrednio także o roboty. W efekcie jesteś polecany kolejnym użytkownikom. I przeciwnie: na stronach niskiej jakości, z których użytkownicy wychodzą niezadowoleni, znacznie trudniej o skuteczne SEO.

Weryfikacja szybkości wczytywania witryny

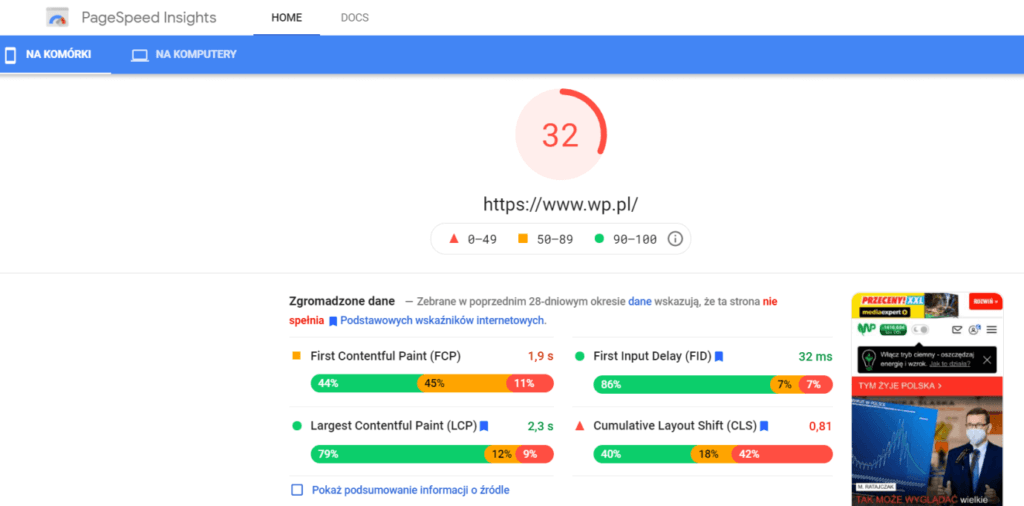

Jednym z kluczowych elementów oceny jakości strony internetowej jest szybkość ładowania/wczytywania strony głównej i podstron. Zależy od czynników takich jak ciężar i wielkość zdjęć, liczba widgetów i pop-upów, polecenie cache’owania w kodzie HTML bądź jego brak, wielkość/rozbudowanie witryny.

Na prędkość wczytywania ogromną uwagę zwraca algorytm Google, ale przecież dla użytkowników także ma znaczenie, jak długo muszą czekać na zobaczenie treści, po które weszli na stronę. Współczesny użytkownik nie ma czasu do stracenia – chce mieć wszystko „na już”. Po to płaci za szybkie łącze internetowe, aby korzystać z sieci bez opóźnień.

– narzędzia do sprawdzania szybkości ładowania strony internetowej

Najpopularniejsze, darmowe narzędzie do sprawdzania prędkości wczytywania witryny to PageSpeed Insights od firmy Google. Jest bajecznie proste w obsłudze. Wystarczy wpisać adres URL serwisu, kliknąć „analizuj”, i gotowe! Po kilku sekundach pojawi się raport dotyczący elementów ładujących się poprawnie, a także tych, które wymagają naprawy. Mało tego! Otrzymasz nawet podpowiedzi dotyczące zmian. Sprawdzisz, w której linijce kodu występuje problem.

Jak sprawdzić poprawność kodu CSS i HTML strony www?

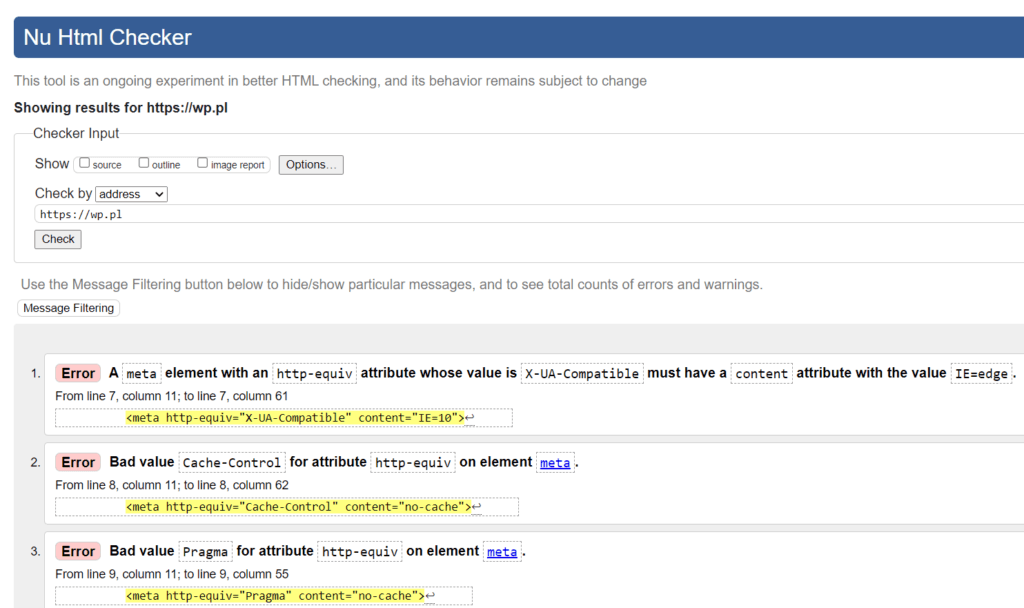

Powolne ładowanie czy błędy na stronie widoczne dla użytkowników i/lub robotów Google mogą wynikać z niepoprawnego kodu CSS bądź HTML. Przykładowe błędy to sprzeczne polecenia, brak ważnych komend, niedomknięte znaczniki.

– przykłady narzędzi do sprawdzania poprawności kodu CSS/HTML

Sprawdź swoją stronę internetową pod kątem poprawności kodu w trzech prostych, bezpłatnych narzędziach. Nu Html Checker pozwala na zweryfikowanie kodu HTML. Otrzymasz informacje o komendach, które są niepotrzebne, niewymagane, przestarzałe, błędne. Z kolei dzięki narzędziu W3C CSS Validator dowiesz się, jakie działania należy podjąć odnośnie kodu CSS. Na koniec zweryfikuj dane strukturalne poprzez Narzędzie do testowania uporządkowanych danych firmy Google.

Uwaga! Dane ukazane w raportach wykraczają poza podstawowe informacje o stronach internetowych. Jeżeli chcesz dokonać zmian w witrynie bez ryzyka uszkodzenia kodu i zablokowania serwisu, skontaktuj się z webmasterem.

Jak sprawdzić mobilność stron internetowych?

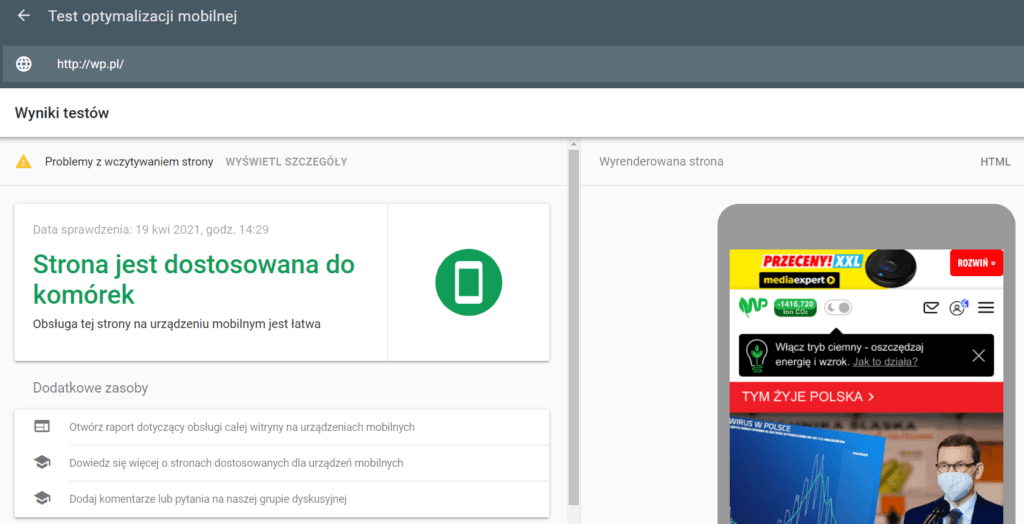

Wdrożenie optymalizacji strony internetowej pod kątem urządzeń mobilnych – takich jak telefony czy tablety – to nie tylko zadbanie, żeby dało się ją wyświetlić na owych urządzeniach. Ważne jest jeszcze, by wyświetlały się poprawnie, automatycznie dostosowywały do rozdzielczości ekranu, zawierały odpowiednio rozmieszczone elementy, klikalne linki i atrakcyjnie zaprezentowane treści wizualne. Wygląd strony internetowej na urządzeniach mobilnych i desktopie może się różnić – to nic złego. Najważniejsze, żeby witryna każdorazowo była funkcjonalna.

Przeczytaj artykuły o wersji mobilnej strony oraz funkcjonalności responsywnej:

– narzędzia, którymi możesz sprawdzić mobilność serwisu

Podobnie jak w przypadku sprawdzania prędkości wczytywania, pod kątem optymalizacji mobilnej stronę zbadasz w darmowym narzędziu Google. W polskiej wersji nazywa się ono Test optymalizacji mobilnej. Do podstawowych danych ma dostęp każdy. Natomiast aby wyświetlić szczegółowe informacje, musisz zalogować się na swoje konto w usłudze Google Search Console.

Jak sprawdzić jakość strony internetowej pod kątem bezpieczeństwa?

Czy na Twojej stronie bezpieczeństwo stoi na najwyższym poziomie? Czy witryna internetowa korzysta z wiarygodnego certyfikatu SSL? Aktualizujesz CMS, wtyczki i szablony? Korzystasz jedynie z wtyczek i szablonów zweryfikowanych firm?

Aby Twoja strona wyświetlała się wysoko w wynikach wyszukiwania, a tym bardziej uniknęła przypisania komunikatu o potencjalnym zagrożeniu, powinieneś zadbać o podstawy, na które zwróciliśmy uwagę w powyższych pytaniach. Przede wszystkim zmień adres URL z http:// na https:// (zrobisz to, wdrażając certyfikat SSL). Następnie wykonaj kopie zapasowe serwisu i dokonaj niezbędnych aktualizacji wtyczek. Jeśli z jakichś nie korzystasz – usuń je.

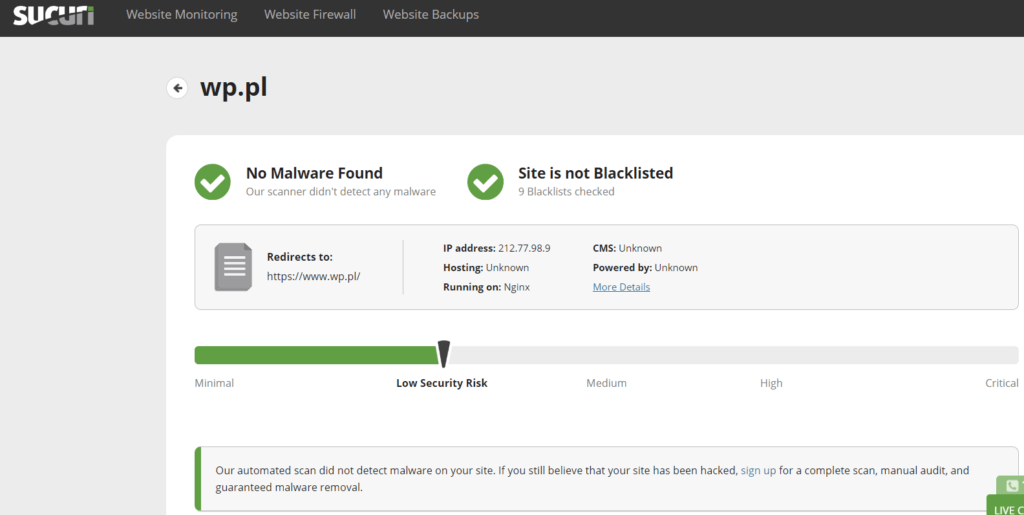

– w tych narzędziach sprawdzisz, czy strona www jest bezpieczna

Jakość bezpieczeństwa strony zweryfikujesz w nieodpłatnym narzędziu Free website security check & malware scanner od Sucuri. Dowiesz się, podjęcia jakich akcji wymaga strona. Jeżeli zaś jeszcze nie wdrożyłeś certyfikatu SSL i zastanawiasz się, którą firmę wybrać, wpisz jej adres URL w narzędzie SSL Labs od Qualys, dzięki czemu ocenisz jakość dostarczanej przez nią usługi.

Analiza wyświetlania serwisu w różnych przeglądarkach internetowych

Mimo iż od kilku lat najpopularniejszą przeglądarką internetową jest Chrome, nie powinieneś zadowalać się faktem, że Twoja strona internetowa wyświetla się w niej prawidłowo. Twoimi potencjalnymi klientami równie dobrze mogą być użytkownicy przeglądarki firmy Apple (Safari), korzystający z Firefoxa czy przeglądający sieć www przez Internet Explorer. Zbadaj, czy na nich również witryna działa poprawnie. Zwróć uwagę na to, czy szablon się nie „rozjeżdża”, wszystkie elementy są wczytywane, linki da się klikać (produkty kupować, e-booki ściągać itd.), a kod HTML nie generuje błędów.

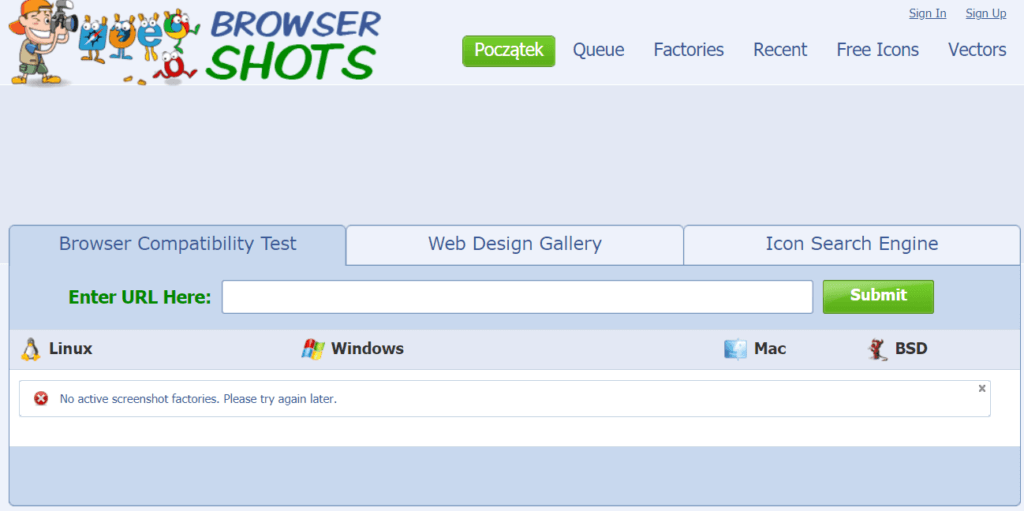

– narzędzia do uzyskania informacji o stronie pod kątem dowolnej przeglądarki

Popularne, proste i darmowe narzędzie do sprawdzania sposobu wyświetlania strony internetowej w sieci to Browser Shots. Niestety nie wszystkie funkcje w nim działają. W efekcie skuteczniejsze jest korzystanie z narzędzi płatnych, np. CrossBrowserTesting, Cross Browser Testing Cloud, LambdaTest, Sauce Labs. Ponadto poprawność wyświetlania strony możesz sprawdzić ręcznie, ściągając przeglądarki i wykonując w witrynie proste operacje: dokonanie zakupu, wypełnienie formularza, dodanie adresu e-mail do newslettera, pozostawienie komentarza, udostępnienie artykułu.

Jak sprawdzić efektywność słów kluczowych?

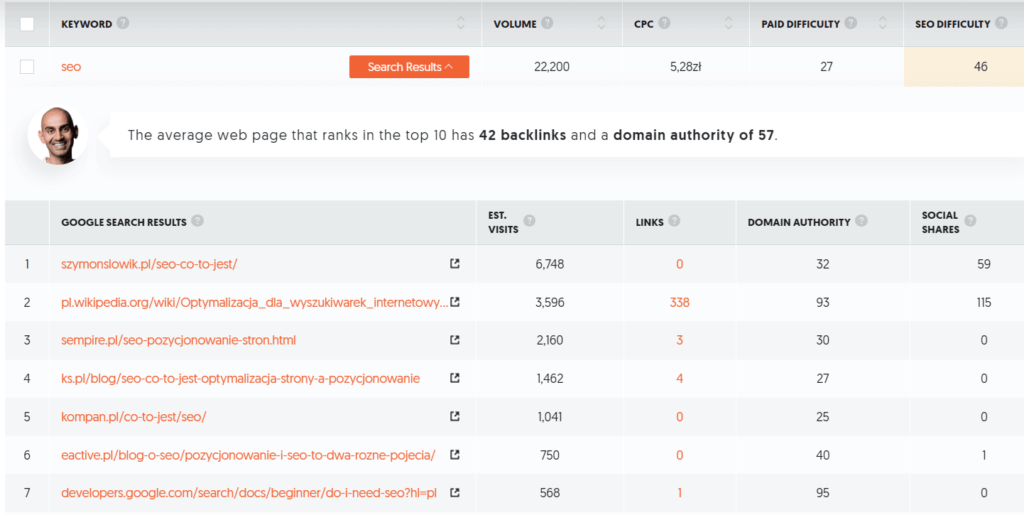

Jeśli chcesz sprawdzić efekty podejmowanych działań SEO i poprawić widoczność strony na wybrane słowa kluczowe, najpierw powinieneś zweryfikować pozycje, na których znajduje się Twoja witryna obecnie. O sposobach sprawdzania pozycji strony napisaliśmy kompleksowy artykuł: Jak sprawdzić pozycję strony w Google?, do przeczytania którego zachęcamy. Tutaj przypomnimy jedynie, że nie wystarczy wpisać frazę w Google i wyszukać. Ręczne działania obarczone są wieloma błędami, wynikającymi m.in. z historii wyszukiwania, lokalizacji, profilu użytkownika konta Google. To, że zobaczysz serwis wysoko na liście wyników wyszukiwania, nie oznacza wcale, że znajdą go tam również Twoi potencjalni klienci.

– lista narzędzi SEO do weryfikacji słów kluczowych

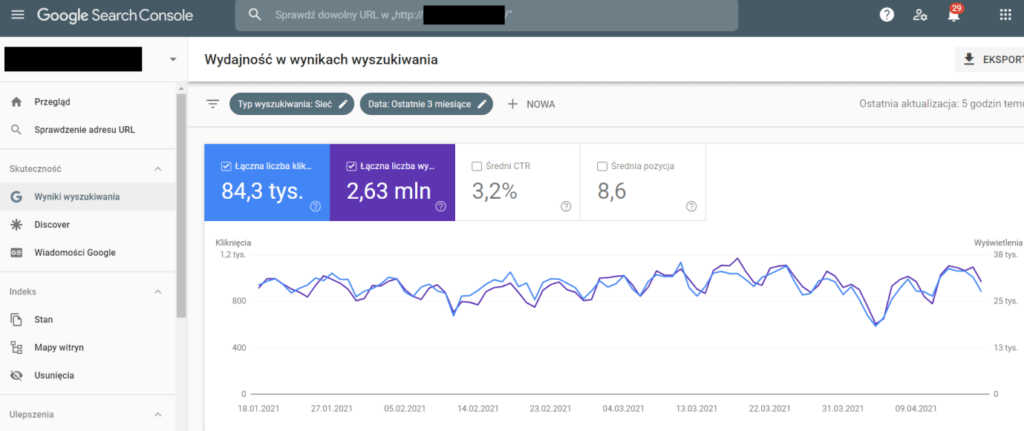

Darmowe narzędzia do sprawdzania widoczności strony na wybraną frazę kluczową to np. Ubersuggest i Anonymous Ad Preview Tool. Audyt niestety jest podstawowy, bo narzędzia mają ograniczenia. Znacznie więcej wyników znajdziesz w panelu Google Search Console. Polecamy też skorzystanie z rozbudowanych, płatnych narzędzi typu Semstorm, Senuto. Dwóch ostatnich – oraz im podobnych – używają agencje SEO.

Ogólna widoczność strony internetowej w Google

Warte uwagi jest także sprawdzenie ogólnej widoczności w internecie połączone z analizą konkurencji. Dzięki porównaniu stron internetowych – swojej i rywali – dowiesz się, kto zdobył widoczność na więcej fraz, jakie to frazy oraz jakie przysługują im pozycje. Zestawienie wyników pozwoli Ci ocenić, które frazy warto pozyskać, by rozszerzyć działania SEO i trafić do nowych użytkowników, np. korzystających z fraz z długiego ogona.

– narzędzia, którymi można sprawdzić stronę pod kątem widoczności

Jak sprawdzić jakość strony internetowej pod kątem ogólnej widoczności? Możesz wykorzystać te same narzędzia, które zaprezentowaliśmy wyżej, niestety płatne: Senuto, Semstorm (zaletą jest dostęp do danych o konkurencji). Zajrzyj też do swojego panelu Google Search Console, w którym dostaniesz pełne informacje o widoczności: podstronach online, czyli zaindeksowanych przez roboty, a także o wyindeksowanych – celowo bądź w wyniku błędów na stronie. Zapoznaj się z uwagami i ostrzeżeniami, jeśli występują.

Zalety analizy profilu linków

Czy wiesz, jaki profil linków ma Twoja strona internetowa? Sprawdziłeś to kiedykolwiek? Jeśli nie – koniecznie zrób to teraz. Na wyniki SEO wpływają liczba i jakość linków przychodzących. Naturalnemu profilowi linków oraz niekorzystnemu wpływowi nienaturalnych linków poświęciliśmy osobne artykuły – przeczytaj zawarte w nich porady, by pozycjonować stronę skutecznie i bezpiecznie, bez ryzyka otrzymania kary od Google.

– za pomocą tych narzędzi dokonasz analizy linków

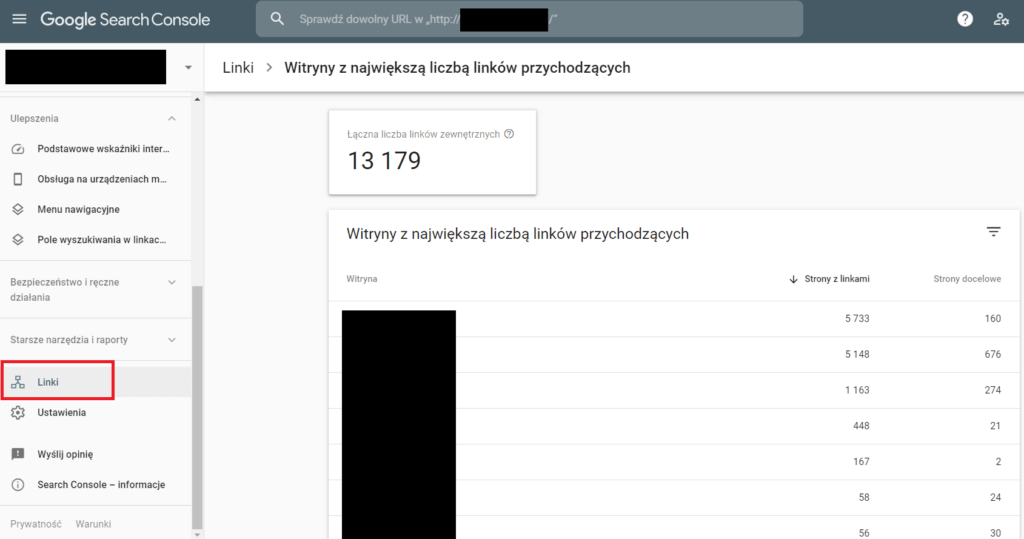

Analizy linków przychodzących i wychodzących dokonasz za pomocą serwisów Majestic czy Ahrefs. Każde narzędzie pozwala na weryfikację anchorów, atrybutów i stron, z których pochodzą odnośniki. Każde też zawiera listę wyników, które możesz pobrać, np. gdy konieczne będzie zrzeknięcie się części linków negatywnie wpływających na pozycjonowanie strony. Ponadto bardzo ograniczone, podstawowe dane na temat liczby i źródeł linków znajdziesz w Google Search Console w zakładce „Linki”.

Przegląd elementów strony www: widgetów, pop-upów, formularzy

Wykrycie niektórych błędów możliwe jest nawet dzięki działaniom ręcznym. Jak wspomnieliśmy podczas omawiania czasu wczytywania strony, na prędkość wpływ mają różne dodatkowe elementy i ozdobniki. Ponadto rozpraszają one uwagę użytkownika, nierzadko zasłaniają mu treści, które czyta, doprowadzają do irytacji i wyjścia z witryny.

Spraw, by strona była przejrzysta i czytelna, usuwając wszystkie zbędne elementy. Jeżeli uważasz, że dany pop-up jest niezbędny, opóźnij jego pojawianie się, a także ustal limit wyświetleń, aby nie pojawiał się użytkownikowi kilkakrotnie podczas jednej sesji na stronie. Ponadto zadbaj o użytkowników urządzeń mobilnych – zablokuj wszelkie wyskakujące okna w mobilnej wersji witryny.

Znaczenie treści dla jakości stron internetowych (dane meta, opisy, artykuły)

Narzędzia nie są Ci koniecznie potrzebne również do oceny jakości treści na stronie www. Analiza elementów tekstowych i wizualnych (zdjęć, filmów) jest oczywiście łatwiejsza w przypadku małego serwisu, niemniej nawet podczas badania dużej strony powinieneś sobie poradzić. Najważniejsze są podstrony stałe, zwłaszcza z ofertą, i ukazane na nich treści. Dane meta – tytuły i opisy – zweryfikujesz darmową wtyczką do CMS-a, np. popularnym wśród użytkowników WordPressa narzędziem Yoast. Przeczytaj więcej o funkcjach, jakie pełnią title i meta description:

- Pozycjonowanie stron poradnik – część 1. Meta title: SEO Case Study

- Pozycjonowanie stron poradnik – część 2. Opis strony – meta description

Sprawdzenie treści pod kątem użytkowników

Treści przygotowywane dla użytkowników powinny być na najwyższym poziomie. Zadbaj o merytorykę. Jeśli wyczerpiesz temat interesujący czytelnika, sprawisz, że ten nie pójdzie do Twojej konkurencji, bo nie będzie miał powodu. Pamiętaj o poprawności językowej, ale jednocześnie dostosuj język do formy przekazu i profilu użytkowników (jeśli nie piszesz do specjalistów, zrezygnuj z branżowych wyrażeń).

Formatuj tekst, używając nagłówków, akapitów, punktorów, wytłuszczeń. Stosuj linki, jeżeli chcesz odesłać czytelnika do wartościowej strony zewnętrznej bądź podstrony w swoim serwisie. Nie przesadzaj z liczbą linków ani słów kluczowych. Tekst powinien wyglądać naturalnie, by użytkownicy nie pomyśleli, że stanowi bezwartościową, nachalną reklamę.

Informacje dla robotów Google i innych wyszukiwarek

Oceń jakość tekstów również pod kątem robotów. Zadbaj o właściwe nasycenie słowami kluczowymi i naturalne ich rozmieszczenie (zagęszczenie). Ważne frazy stosuj w nagłówkach i linkach (anchorach). Nie zapomnij o uzupełnianiu opisów alternatywnych zdjęć i danych meta.

Sprawdź, czy nawigacja działa poprawnie i do wszystkich ważnych podstron w domenie prowadzą linki. Jeżeli nie, roboty mogą mieć problem z dotarciem do nich, wobec czego zaindeksowanie w Google zajmie sporo czasu. W razie napotkania trudności przeczytaj, co możesz zrobić, by przyspieszyć indeksację nowych podstron i zaktualizowanych treści w starych publikacjach: Jak dodać stronę do Google?

Osobne testy jakości strony dla urządzeń mobilnych i desktopowych

Poprawność kodu, prędkość wczytywania stron internetowych, rozkład elementów szablonu czy ich responsywność warto sprawdzać osobno dla strony wyświetlanej na desktopie, osobno zaś dla wczytywanej na urządzeniach mobilnych. To istotne zwłaszcza w sytuacji, w której witryna zmienia układ szablonu w zależności od rozdzielczości ekranu, tak jak ma to miejsce chociażby na Facebooku czy w wielu sklepach internetowych.

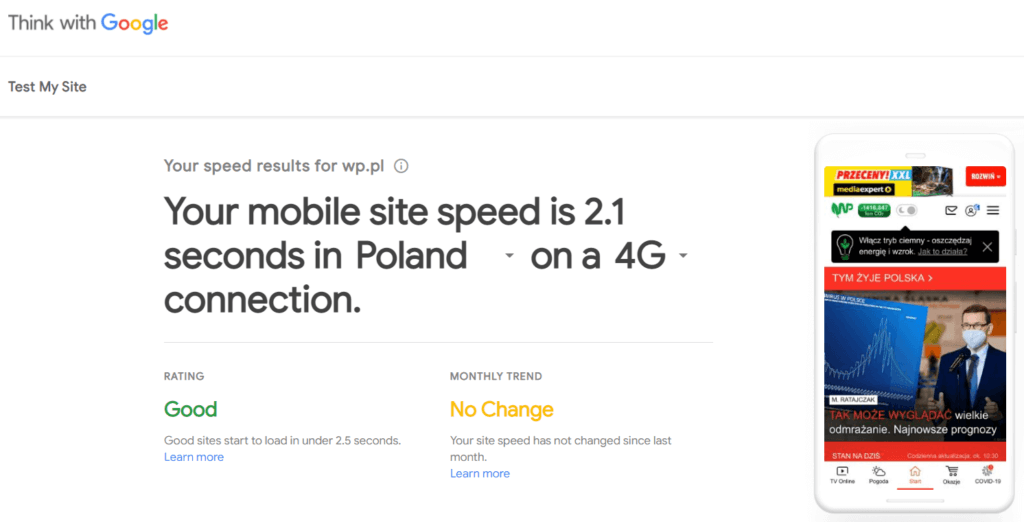

Podstawowe informacje na temat jakości strony internetowej w wersji mobilnej uzyskasz np. w narzędziu Test My Site na platformie Think With Google. Z kolei jeśli potrzebujesz informacji o poprawności wdrożenia standardu AMP, wykorzystaj Test AMP – narzędzie od Google.

Jak sprawdzić jakość strony pod względem UX? Przejście przez stronę jako użytkownik

Wskaźniki UX, czyli User Experience, oceniają doświadczenie (zadowolenie) użytkowników z korzystania ze stron internetowych. Aby wartości były korzystne i sprzyjały SEO, strony powinny szybko się ładować, mieć poprawną strukturę linków (nawigację), być zoptymalizowane pod kątem ludzi i robotów wyszukiwarek. Poprawność ścieżki zakupowej czy dowolnej innej drogi do założonej konwersji należy sprawdzać w różnych przeglądarkach i urządzeniach: laptopie, tablecie, telefonie.

Podstawowe dane UX zweryfikujesz w narzędziu Google Analytics podłączonym do witryny. Zwróć uwagę na liczbę użytkowników i sesji, długość sesji, współczynnik odrzuceń. Sprawdź, które podstrony wygenerowały największy ruch. Jeśli ustaliłeś cele konwersji, regularnie weryfikuj, czy są realizowane. Sprawdzanie stanu zadowolenia klientów na bieżąco pozwoli Ci szybko reagować, wdrażać zmiany i poprawiać jakość strony.

Dzięki płatnemu narzędziu Crazy Egg, na szczęście z długim darmowym okresem testowym, sporządzisz mapę cieplną strony (heat map). Przekonasz się, które elementy Twojej strony www wzbudzają największe zainteresowanie, które linki klikane są najczęściej, a nawet w których momentach podczas czytania artykułów użytkownicy się zatrzymują.

Walidacja dostępności stron www

Istotnym elementem wpływającym na jakość witryny jest jej dostępność. Chodzi o czytelność dla każdego użytkownika, niezależnie od jego potencjalnych niesprawności. Przykładowo treści w witrynie powinny być odpowiednio duże, by mogły je odczytać osoby z wadą wzroku. Zostawianie nieopisanych elementów, np. zdjęć, jest błędem, ponieważ nie „zobaczą” ich osoby niewidome. Przy okazji warto wdrożyć automatyczny odczyt treści, choć nie jest to konieczne, jako że osoby niewidome korzystają ze specjalnych czytników ekranu. I odwrotnie: dla osób niesłyszących dobrze przygotować transkrypcje, jeżeli publikujesz podcasty albo materiały wideo.

Istotne są też poprawne kontrasty kolorów, jasność, możliwość obsługiwania witryny jedynie za pomocą klawiatury, teksty wyrównane do lewej strony. Przykładowy test witryny w odniesieniu do dostępności wykonasz chociażby w narzędziu Validator dostępnym w domenie Utilitia.

Profesjonalny audyt serwisu – zalety audytu agencji SEO

Zagadnienia, metody i narzędzia ukazane w niniejszym artykule pozwolą Ci ocenić jakość strony na podstawowym poziomie. Jeżeli tyle Ci wystarczy i chcesz rozpocząć pozycjonowanie na własną rękę, koniecznie zajrzyj na nasz blog i zapoznaj się z artykułami, dzięki którym uzyskasz bezpiecznie efekty i długofalowe korzyści. Stworzyliśmy poradniki dotyczące optymalizowania strony i już istniejących treści, tworzenia nowych podstron czy artykułów, a także pozyskiwania linków. Zachęcamy do poszukiwania cennego kruszcu w naszej kopalni wiedzy.

Masz pytania lub chcesz skorzystać z pomocy specjalistów SEO? Skontaktuj się z nami, a przeprowadzimy kompleksowy audyt witryny z wykorzystaniem rozszerzonych, płatnych narzędzi i podamy Ci pełne informacje o jakości strony. Stworzymy raport z uwagami i wskazówkami dotyczącymi optymalizacji. Możemy naprawić błędy, zbudować silny profil linków, wzbogacić Twoją stronę o nowe treści – wykonać wszystko to, dzięki czemu widoczność i rozpoznawalność serwisu w internecie wzrosną. Czekamy na Twoją wiadomość!

Zapoznaj się z ofertą pozycjonowania strony internetowej w FunkyMedia.